Главная

»

Самолетостроение

»

Теория информационных процессов и систем

»

Основные понятия и определения теории информации.Мера количества информации.

Основные понятия и определения теории информации.Мера количества информации.

Основные понятия и определение теории информации.

Мера количества информации.

В теории информации изучаются количественные закономерности передачи, хранения и обработки информации. Основное внимание уделяется определению средней скорости передачи информации и манипуляции этой скоростью.

В основе определения меры информации лежит вероятностный подход. Принято исчислять кол-во информации в логарифмических единицах.

Р(а)-вероятность сообщения

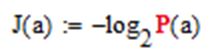

J(a)- количество информации

J(a)=log(1/P(a))=-logP(a)

Т.к. 0<P(a)<=1 то кол-во информации равно 0

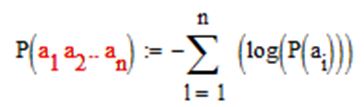

Кол-во информации содерж. В нескольких независимых сообщениях равно сумме кол-ва информации в каждом из них.

Основание логарифма К может быть любым, но для двоичных каналов К=2. Тогда

[двоичных единиц][бит]

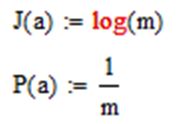

Если в двоичном канале символы P(0)=P(1)=0.5

J=1 бит/символ.

1 бит это кол-во информации, которое содержится в одном из 2х равновероятных событий.

Ансамбль сообщений образует полную группу событий.

Если сообщения равновероятны, то количество информации в каждом из них определяется:

Количество информации в сообщении зависит от его объема алфавита.

Друзья! Приглашаем вас к обсуждению. Если у вас есть своё мнение, напишите нам в комментарии.